スペクトル解析は、オーディオ素材をより細かく制御を行使するために、より高度な方法のひとつです。フェアライトは1979年に導入されて以来、エレクトロニックミュージシャンは、長年のオーディオの音色の質を改善するためにこのテクニックを使用している。

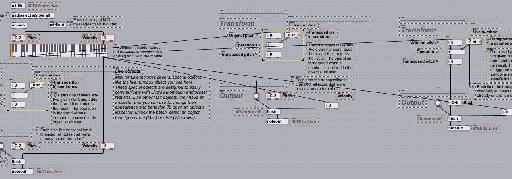

今日我々はそのようなマックスMSPとPure Dataなどの革新的なツールのように、エレクトロニックミュージシャンとしてロックを解除できる大きさのより深いため、との機能を組み合わせたライブでは 、最近リリースされたマックス 、あるのAbleton LiveとMax MSPが。

この方法論の一つのような実装では、これらの製品を拡張する外部ソフトウェアの使用です。マックスMSP用Soundhackの外観は、オーディオファイルに到達し、内部のそれを反転、または完全に音を再現するために、材料からの周波数の一部を収集するためのパスの無数を提示。スペクトル合成のいずれかのアナロジーはジャクソンポロックの作品再び濡らすから樹脂系塗料を作り、そしてブラシとそれを周り渦巻くまたは独自の反復を行うために別のキャンバスに玉掛けのようなものです。

サウンドハック最大MSPの外観は、私たちは、オーディオエンジニアリングのタスクを実行したりすると、以前は不可能と思った。それは完全にコンサートの記録やメディアのイベントからボーカルや観衆のノイズを除去することが可能であればオーディオエンジニアとして、私は頻繁に友人から聞かれます。 "印刷"のオーディオ素材を並べ替えの記録の隣接する周波数で結ばれ、隣接した周波数から自由に困難なので、これは、決して小さな仕事できなくなる。

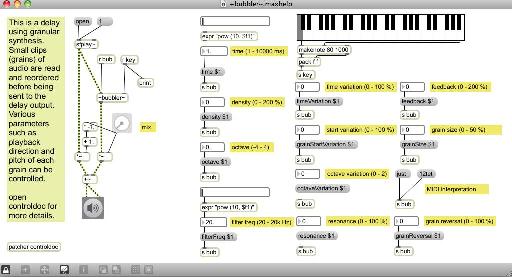

音ハッキングのより多くの創造的応用としては、オーディオ、"穀物"の再生をランダム化し、リアルタイムにピッチと音量を変更するには、小さなビットに分割するオーディオへのグラニュラーシンセシス技術を採用することができます。

マックスのSoundhackのバブラー外部を介して実行、私は私の友人ジーニーから受信したボイスメールをチェックしてください。

SoundHack

上のビデオはprojBoxのビデオコントローラを介して実行されているジョセフグレーで処理パッチに起因しています。私は特に最近、魅力的な発見した一つのアプリケーションでは、 マックスMSPと処理を使用してペイントし、音を使用して、 共感覚と呼ばれる対話型パフォーマンス/インスタレーションです。私はマックスMSPジッタライブのためにマックスを経由してAbleton Liveを扱う、とさえにこれを統合するに進行中の我々の研究として、オーディオとビジュアルのユニゾンで詳しく説明する予定のAdobe Creative Suite 。

Max4Liveとマックスを統合するには、を使用して最大MSPのパッチを配線することができるAbleton Liveに本当に創造的なミュージシャンのために宇宙を切り開くさらに限界に挑みに見える、。

のは、ライブ使用Max4Liveに私たちのSoundHackによって処理ボイスメール、およびマックスからトリガーノートを見てみましょう。私が持っていたという考えは、私の友人ジーニーの声は、すでにかなり美しいですが、キーなしで何かを使用して、ボイスメールの材料からコードを作成し、そしておそらくより多くのフルートやオルガンのようなものに変えることでした。

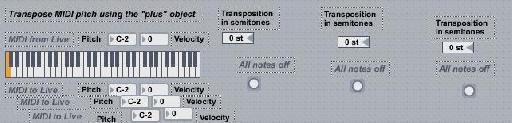

我々は、和音の構造を作成する必要がありますので、ここではC3のルートノートを取る、とCのコードのために、2と4に転置私たちのルートに2つ以上の音符を追加してみましょう。これは我々のMIDIコントローラのノブに転置をマッピングすることで、好きなら私たちの和音が動的に変更できるようにするために、私たちから選択するには、2高調波を与える。その後、我々は、短いコード進行をするために和音を再サンプリングし、異なるピッチで、全体としてそれらを再生することができます。このため我々はMax4LiveのカスタムMIDI transposerとコードジェネレータのパッチによって駆動される処理されたボイスメールを、含むようにAbletonののシンプルな楽器を使用します。

私はiTunesでwavファイルにエクスポートmp3として保存されて、Googleの音声からボイスメールをダウンロードし、"開く"ボタン(図2を参照)をクリックする外部バブラーsoundhackでそれをオープンしました。私はその後、(1は"真"なので、他の言葉で、"先に行くと、ファイルを再生する"プログラマ用語で)オーディオファイルを再生する"1"のメッセージをクリック。私は結果を記録するためにQuickTimeのキャプチャオーディオ機能を使用する。私はM4Lを経由してライブにマックスからオーディオをルーティングへの最大の能力を使うこともできたが、今後のチュートリアルでその方法私はあなたが表示されます。私は結果として処理されたオーディオファイルを開いたとAbletonの簡素楽器にそれを落とした。私はライブのチュートリアルのためにマックスを開いた後、ライブラリに移動し、Ableton Liveに行くことによってライブチュートリアルのためのいくつかのマックスを通じて辞任し、05 -処理MIDIノートのレッスンを選択、その後M4L.md.04.Transpose.amxd。私はそのキーが場合と、すべて正確に同時に音、となるよう、私、私は単音から和音を作ることができるになるように、チュートリアルさらに2回の変換の領域を(図2を参照)にコピーさらにファイルを変更する機能を拡張し、MIDIコントローラーにトランスポーズ量をマップできます。

私は、カスタマイズされたMIDIノートtransposerのチュートリアル次に、得られたカスタム*. amxdを(Liveに対する最大のファイル形式)にオープンし、よりシンプルな楽器で、それをグループ化、私は私の更改にリモート25 SLコンパクトMIDIコントローラをキーを押すことができるように、とサンプリングされたオーディオの和音を作るためにさらに2つの転置のメモを追加します。

図4

私は、デバイスのラック内のマクロコントロールに"開始"、"ループ"、"長さ"、および"フェード"のコントロールがマップされ、私のオゾンのオーディオインターフェース/ MIDIコントローラーの最初の4ノブに、これらの4マクロをマッピング。このように、私は徐々にあなたが最終的にオーディオが電子オルガンのようなビットを鳴る非常に小さなループ波形に"縮小"聞こえるような小さなループに再生中にオーディオファイルを絞り込むことができます。ノートパソコンのスピーカーの種類のから、私のQuickTimeオーディオのキャプチャと組み合わせてGoogleの音声mp3ボイスの低解像度は、結果私が前に聞いたことがない音色、透き通った輝きを与えます。それは私の友人ジーニーの声(音節の数を繰り返すミリ秒ではあるが)から来たので、おそらくこれは、その年に彼女の声は、本質的にソフトウェアを経由して歌うことに話してから変更され、その点でこの実験に興味深い状況になります!

図5

このような結果として得られるオーディオファイルの音:

[オーディオのid ="738"]

だから、あなたはそれを持って、オーディオのランダムな部分は完全に何か他のものに変身。プロセスを逆に動作させるには時間! OKです、私はすでにバックジーニーと呼ばれる:0)

© 2024 Ask.Audio

A NonLinear Educating Company

© 2024 Ask.Audio

A NonLinear Educating Company

Discussion

Want to join the discussion?

Create an account or login to get started!